深度学习在2017年取得的那些不可思议的突破,将在2018年全面爆发。去年大量研究工作将转移到日常的软件应用中。

跟去年一样,我也将对2018年的深度学习发展方向展开预测。

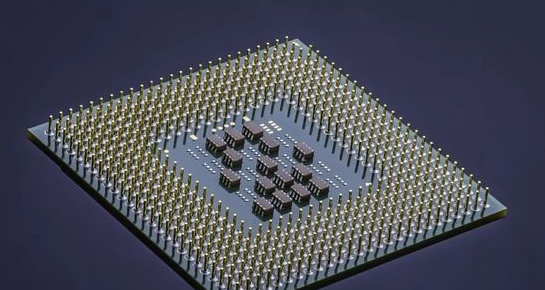

1、多数深度学习硬件创业公司都将失败

许多深度学习硬件创业公司将在2018年最终交付他们的芯片。这些都是半成品,因为他们会忘记提供优秀的软件来支持这些新解决方案。这些公司的DNA都在于硬件。不幸的是,在深度学习领域,软件同样重要。这些创业公司大多不懂软件,也不了解开发软件的成本。这些公司可能会提供芯片,但却没有任何东西会在这些芯片上运行。

英特尔的解决方案将继续推迟,可能会令人失望。记录表明,英特尔无法在2017年年中发布这款产品,谁也无法预测该公司何时能推出这款产品。如果为时已晚,那就只能变成一颗哑弹。

谷歌将继续凭借TPU的开发给世界带来惊喜。谷歌或许会进入硬件业务,将其知识产权授权给其他半导体厂商。如果它继续成为除了英伟达以外唯一一个真正的参与者,这种做法将很有意义。

2、元学习将成为新的SGD

2017年,元学习领域涌现出很多意义重大的研究。随着研究界对元学习的理解整体得到提升,传统的随机梯度下降法(SGD)将被边缘化,转向更有效的方法,将更具爆发性和探索性的搜索方法结合起来。

无监督学习的进步将会逐步加快,但主要将受到元学习算法的推动。

3、生成模型推动新型建模

生成模型将具备更多的科学探索意义。目前的多数研究都是生成图像和语音。然而,我们应该看到这种方法融合到一些工具之中,用来为复杂的系统建模。其中一个领域是用深度学习建立经济模型。

4、通过自我对局来自动化创建知识

能够从头自学的AlphaGo Zero和AlphaZero是一场巨大的飞跃。在我看来,这跟深度学习的出现拥有同等程度的影响力。深度学习发现了通用函数近似器。而自学则发现了通用的知识创造。

预计自学式机器学习还将取得很多进展。

5、可解释性无法实现——我们只能伪造

可解释性有两个问题。较为人所知的问题在于,解释有很多规则,人类不可能全部掌握。第二个问题不太为人所知,那就是机器会创造很多人类完全陌生且无法解释的概念。我们已经在AlphaGo Zero和AlphaZero的策略中看到这种现象。人类认为这种举动超出常规,但它们或许只是没有能力理解这种行为背后的逻辑而已。

我认为,这是个无法解决的问题。相反,机器将很擅长“伪造解释”。简单来说,可解释的机器的目标是理解人类感到舒适的那些解释,或者人类在直觉层面能够理解的解释。然而,在多数情况下,都无法对人类完全解释清楚。

我们需要通过“伪造解释”来提高深度学习的可解释性。

6、通过教学环境实现工业化

想要让深度学习的发展更可预测、更易控制,就需要发展更加具体的教学环境。我之前有过详细阐述。如果你想知道教学技术最为粗糙的表现形式,只需要看看深度学习网络是如何训练的即可。我们都会在这一领域看到更多进步。

预计将有更多公司披露他们的内部基础架构,从而揭示他们是如何大规模部署深度学习的。

7、对话式认知崛起

我们评估通用人工智能的方法过于陈旧。需要通过一种新的范式来解决现实世界的复杂动态。我们未来一年应该看到这一领域出现更多进展。我将在3月1日和2日在阿姆斯特丹的Information Energy 2018大会上探讨这种新的对话式认知范式。

8、我们要求对人工智能的使用符合道德标准。

将有越来越多的人要求人工智能的使用遵守道德标准。人们目前越发意识到自动化失控后产生的恶劣后果。Facebook、Twitter、谷歌、亚马逊等平台上使用的简单的自动化技术都会产生意想不到的社会影响。

在部署那些能够预测人类行为的机器时,我们需要理解其中的伦理道德问题。面部识别就是一项比较危险的功能。能够生成以假乱真的媒体资料的算法会成为大问题。整个社会都应该要求人工智能为社会的整体利益考虑,而不能加剧社会的不平等。

预计未来一年将看到更多关于人工智能伦理问题的讨论。然而,应该不会有新的监管措施出台。政策制定者还需要再过几年才能真正理解人工智能对社会的影响。我不认为他们会停止斗争,解决社会面临的真正问题。美国人口受到很多安全问题的影响,但我们并没有看到新的立法来解决这些严重问题。所以,不要奢望这些问题一夜之间得到解决。

为影响做好准备

2018年很重要,我们都应该系好安全带,迎接即将到来的重大影响。

2020-02-15 11462

2018-01-03 10678

2021-03-18 7861

2018-06-01 6912

2019-06-22 6302

2019-05-03 6057